デジタルリバーブの理解は相当難しい

2025/11/27 更新

皆さん、Black Friday の真っ盛りだと思いますが、いつもながら私は独自路線を行きます。この時期に全く脈絡なぞ関係なく Reverb の話をします。

—

私はレコーディング、ミックスエンジニアとして毎日デジタルリバーブを触っている人ではありますが、実は Reverb にフォーカスした記事はこのサイトを開いてからもうすぐ 6 年ですが、一度も書いていません。

何故かというと「マジで書くことがない」からです。

書くことがない、というと Reverb 軽視に見えると思いますが、厳密には「Reverb についてをエンジニア視点で上手に語ることができない」ということです。

あと、自分の考える Reverb に対する向き合い方は、世間一般の感覚とは全く異なり、そもそもどうせ理解されないでしょうし、お前は間違っている、と盛大に言われることがわかりきっている、からでもあります。

ですから、自分の考えを開発者の意見を交えて、それらがどのように相互に関係するのか、ただ、考え方を説明するだけであって、この記事内容をあなたが有効的に自分の制作に活かせるか、というのはほぼ無理かもしれません。

ですから、あまり書きたくなかったというか、上手く書けないので今まで封印してきたのですが、やはり現代の Reverb の考え方が非常にペラいというか薄いというか、そういう感覚というか…個人的には教えられてきたことが全く違うと感じることが、この業界には蔓延っているので、理解されないけど、言っておく、程度に記事にまとめたいと思います。

そもそも、デジタルリバーブのパラメータを理解して使うのが難しすぎる、という問題がある。高度な音響物理学や空間音響の応用的な話を理解してないのに、デジタルリバーブを制御することがまず難しいため、正直「プリセットを利用すること」が一番の近道であり、それが答えになる場合が多い。

リバーブは考え方が多岐にわたる

どうしようもないくらい、Reverb は応用が発展しすぎるので、何故ミックスに於いて Reverb は重要なのですか? と問われても、答えがたくさんあって話せないんです。

ですから、今回は音楽の視点からではなく、デジタルリバーブだけの視点で音楽へのアプローチの方法を説明したいと思います。

ハードウェアリバーブ

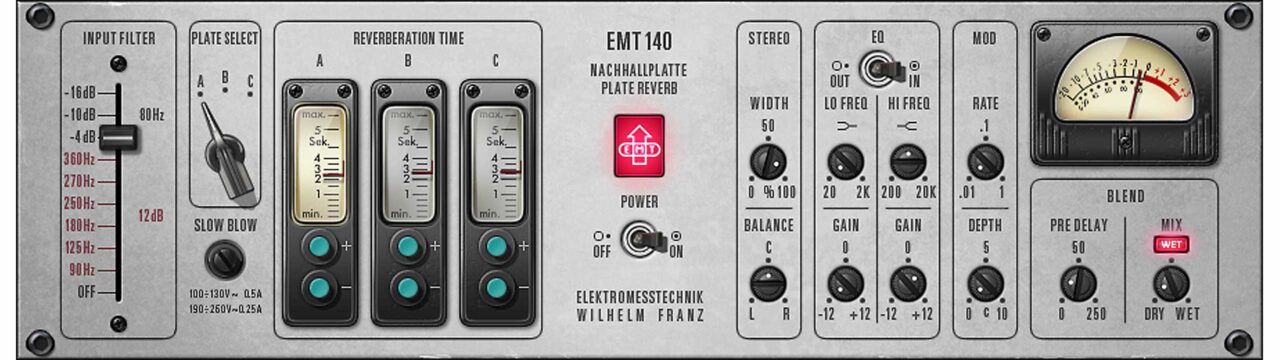

これは EMT 140 (本物の Plate を使った Reverb) もハードウェアといえばハードウェアであり、Lexicon 480L もハードウェアですよね、これらは確実に使い方が決まっています。

その Reverb の音色自体を模索している場合に利用します。

Plate Reverb の音色が欲しい!じゃぁ EMT 140 のプラグインをチョイスしよう!でしかありません。何故 Plate Reverb の音が欲しいのか、そこにはなにか理論があるわけではないんです。そこに高度な裏打ちされたなにか隠された意図があるかと言われたら無いです。強いて言うなら、この曲には Plate がいいのでは?と漠然とした経験則というか勘です。

ハマらない場合は現代であれば別に他の Reverb へ変えれば済む話で、Plate っぽい余韻が欲しいから EMT 140 で調整してみて、上手くいかなければ別のアルゴリズムリバーブの Plate プリセット使おう、くらいの感覚です。私は実機は使ったこと無い。

もし現代で実機の EMT 140 を使う事がある場合は、そもそも実機の EMT 140 を使うことが目的化になりませんか。もちろん求める音が実際の EMT 140 である!と言い切れるならいいのですが、それでも普通に考えて、当時の Plate Reverb の質感が欲しいんです。実機を使ってみたいんです。だと思うんですよね。実機を使うのが割と目的ですよね。そうすると当時の EMT 140 と同じようなプロセスが得られますから。現代では Plugin という選択がありますが、EMT 140 を積極的に選択する理由は、当時の質感と同じものが得たいであり、そこに EMT 140 への深い理解は必要ないんです。曲のテンポや雰囲気に合わせて設定するだけです。

上記の画像は EMT 140 のプラグイン版ではあるが、調整幅を見ると、この Plate Reverb の質感が欲しい、という場合でしか説明できない。そこにあるのは曲に合わせた Reverbration Time 調整と EQ、そして軽微な質感の調整だけであり、これがなにか楽曲に積極的に介入させる意図で利用は難しい。

要は、Plate Reverb を使いたい、というツールの考えが先にくるのである。

そして、もし、あなたがさらなる自由度を Plate Reverb に求める場合、EMT 140 は絶対に選択肢に入らなくなるということである。

Lexicon 480L または 960L

何故 Lexicon の 480L、960L や Relab LX480 という Plugin がミキサー界隈で重宝されるかというと、現役でも使っている人が多いからです。で、実際現場で使う時はとりあえず 480L または 960L のプリセットをポン出しするだけ、なんてことはめちゃくちゃ多いんですよ。もちろん、そのあと曲に合わせて調整すると思いますが、これは現在でも SSL とか卓があるスタジオで 480L や 960L を立ち上げておく必要がある人は全員理解してくれると思いますが、実務経験がない人にとってはよくわからないことを言っているだけだと思います。

これは現場で 480L を使う理由はモニター側に Reverb を立ち上げておいて AUX で 480L に信号を送っておきたい、という理由なだけでミックスに積極的に 480L の実機を使う人は今は少ないと思います。これはそもそもアナログマルチチャンネルミックスをしないからですね。

そうなると ITB + α がかなりの現実的な割合を占めている現在の制作環境的に、Relab の Plugin が便利なんです。ただ、やっぱりスタジオでいつも聴く Reverb の音なんですよ、ついついプラグインでも挿しちゃうのはそいうところで。

で、何故 Reverb を使うか、なんですが、なんか使わないとそれっぽく聞こえないから、です。マジで現場で Reverb を使う理由は音楽のため、ではあると思うのですが、確たる言語化ができません。なぜなら Reverb が聞こえないとアーティストが歌いづらかったり、なんとなく音楽としてのっぺりするから、とか、視聴してもらう方に判断がつきやすいため、とか逆に切って聞かせてください、もあるので、とりあえずなんです。

基本 Reverb は使う、という既成事実があって、もし使わない場合は前もって、Reverb は無しでお願いします、というやり取りがある前提なので最初から立ち上げておく、ということです。ハードウェアの Reverb というのはそういうものなのです。もちろん FOH とかだと普段積極的に私はエンジニア業務しないのでそれらの考えとは全く違うことを念頭においています。

自分もやっぱりハードウェアにハマった時期がありまして、中古で YAMAHA の SPX500 とか買ってきてポチポチして遊んだ経験があります。ハードウェアの Reverb は Digital Vintage 化しているものがあって、そもそもその Digital Reverb を使うこと自体が目的になることが多い、ということです。

そこにはなにか理論構造が明確にあるわけではなく、この音楽にはこの Reverb が合うだろう、インスパイアが 1980 年代スタイルだからその当時の Reverb の質感や独特のディティールが欲しいので、当時のデジタルハードウェア製品を使ってみる、など、ミックスというより音作りの側面が強いです。

Reverb のモデリングプラグインはそれ自体を求めている場合に利用します。なにか特にこれと言ったアプローチがあるわけでありません。

もちろん、今でも第一線で使える Reverb であることに変わりありませんが、1980 年代 1990 年代に登場したデジタルリバーブに学べることは非常にたくさんあります。これらアルゴリズムリバーブの詳しいディティールを学ぶことによって、現代音楽へのアプローチの選択が増えるのです。

結局は音楽の歴史を知れ、という普遍的な問題回帰になる。

やはり、音楽の歴史は重要で、デバイスを制作者の意図通りに使うためには、当時利用された Reverb の定番を抑えておく必要があって、結局は文脈理解の話に発展するために、Reverb の使い方を説明できなくなる要因となる。

例えば、現代では確かに利用は減ったが、細かな利用や特定の表現のためには今でもよく利用されることがある Gate Reverb であるとか。

IR Convolution Reverb

デジタルハードウェアとしてアルゴリズムと対比するのは IR Convolution Reverb です。

これも少しだけ歴史と話すと、Sony が 1999 年に実用的なリアルタイムサンプリングリバーブ、つまり IR Convolution Reverb のハードウェアを発表します。これが実用的な IR Convolution の初の製品らしい。昔の Sony は凄かったのだ。ただ、プロオーディオはなかなか金にならんかったや!

IR Convolution Reverb と聞くと、なんかすごい計算をした Reverb なんだろうなぁ? 的な漠然とした印象を受けますが、Convolution は日本語にすると「畳み込み」といい、これはただの計算のアルゴリズムというか、数学の演算方法の名前であって、なにか僕達に理解できない優れた技術の名前ではないです。

ここでは IR Convolution について詳しくは語りませんが、既に皆さんが「IR → 伝達関数」という事実 (正しくは IR をフーリエ変換したものが伝達関数) を知っている前提で、エフェクトを掛けたい音声信号 (時間領域) に Reverb の IR を畳み込み処理をするわけですが、工学的には「時間領域での畳み込み」は「周波数領域での掛け算」と同じ結果になるため、これを利用して高度なリバーブ処理を簡単な掛け算に変換して高速に実現しているわけですね。

上記の動画の関数が IR の伝達関数に置き換わっているだけと考えるんですね。

実際の Reverb の内部計算がどうかのファクトは横に置いておいて、簡単に言うと IR Convolution Reverb を掛けたい音声信号を高速フーリエ変換して、適応したい IR も高速フーリエ変換して、2 つの変換された値同時で合成して、最後に逆高速フーリエ変換すれば、演算がかなり簡略化されて時間領域の結果が出力できるってやつですね。多分。これは純粋数学の話です。

IR の伝達関数を得るにはラプラス変換を用いるのですが、IR の畳み込み計算は時間領域を周波数領域に変換してから行います。ラプラス変換を利用することは基本なく、時間領域を周波数領域に変換して計算するようです。実際にはデジタルの領域では Z 変換なる用語がでてくるので、難しい話は間違っているかもしれません…

FFT、高速フーリエ変換も畳み込みのアルゴリズムを利用しており、ここでのアルゴリズムの意味は現実的には効率よくコンピュータに演算させるときの考え方、みたいなものでしょうか。効率的に計算させるために色々工夫して演算コードを記述するみたいな話です。ですから DSP 処理の考え方でいうとアルゴリズムは重要だったりします。如何に効率的にかつ高速に計算させるために頭のいい人がその方法を考えるんですね。どこまでいっても数学なんじゃ…

ここで高速フーリエ変換が出てくるとなると評価のために Block Size、サンプル数と窓関数の話に関連し、往々にして処理に遅延が必要だっていうのがわかると理解が深まって来るだろう。わからない人はわからなくていい。これは IR Convolution Reverb の設計の話だから。もちろん世の中にはリアルタイム IR Convolution Reverb は存在する。

まぁ、これは 短時間フーリエ変換 (STFT) 関連のもっと難しい話ですね。正しく設計しないとリバーブの場合はエイリアシングの問題があってかなり複雑みたいです。

これら別の詳しい話が知りたい方はこちらの MK3 さんの note をご覧ください。MK3 さんの note には他にも素晴らしい記事がありますので、ご参考になるとよいでしょう。

IR Convolution Reverb の特徴

IR を利用した Reverb Plugin などは、空間を完全に再現し、リアルな表現を可能にする、とよく説明されます。これは理論的には正しいです。

ただし、現実的にはそうではありません。IR を利用する以上 FIR Filter EQ と同じような事が起きます。計算遅延やディティール保持のための制約があります。

ちょっと AI に聞いてみました。

1. 録音時の環境制約

IR は特定の場所で録音された短い音(通常はインパルスやクリック音)を基にしています。このため、録音時に発生するさまざまな要因がそのまま IR に反映されますが、リアルな空間の音響特性を完全に捉えることは難しいです。

- マイクの配置や種類: IR を録音するためのマイク配置や使用するマイクの特性(指向性、周波数特性など)が、その IR の音質に影響します。異なるマイクで録音した IR は、同じ空間であっても異なる響き方をします。

- 録音環境の制約: 実際の空間には、録音時に予期しない反響や音の干渉が存在することがあります。これらは IR に含まれる可能性があり、理想的な音響空間を完全に再現することは難しいです。

2. 短いインパルス応答の使用

IR は通常非常に短いインパルス(音の瞬間的な反応)を基にしていますが、現実世界では音は継続的に変化し、環境内の多くの要因が同時に作用します。

- 長期的な音響変化: 実際のリバーブ効果は、単一のインパルスに基づく反応だけではなく、時間とともに変化する多くの複雑な反響の組み合わせです。IR はそのような複雑な音響環境を簡単にはキャプチャできません。

- 非線形な効果の無視: 現実の音響環境では、音の反響が非線形的に変化することがあります(たとえば、音量や音の種類によってリバーブの感じが変わる)。IR ではこれらの複雑な変化を再現することは困難です。

3. 音場の全体を捉えられない

IR は特定のポイント(通常はマイクが置かれた場所)から録音された反響のデータに過ぎません。これにより、他の場所での音響特性や、音場全体のダイナミクスを再現することができません。

- ポイントソースに依存: 実際の音場では、音源の位置や聴取者の位置が異なれば、リバーブやエコーの感じ方も変わりますが、IR では通常1箇所で録音された音響情報しか得られません。

- 音場の方向性の不足: 音場の方向性や反射の角度、音源とリスナーの位置関係などが IR には反映されません。これは特にステレオやサラウンドサウンドのシミュレーションにおいて重要な欠点です。

4. 環境の動的変化に対応できない

IR は固定された空間の音響特性を記録したものに過ぎないため、環境の動的変化(たとえば、時間帯、湿度、温度の変化、空間に人が入ることで変わる音響特性など)に対応できません。

- リアルタイムの変化の無視: 実際の空間では、時間や条件によって音の反響の仕方が変わります。IRでは、このようなリアルタイムでの動的な変化を反映することができません。

5. 音響的なディテールの欠如

IR は空間の反響を簡潔に捉えるため、音響的なディテールを全て含んでいるわけではありません。特に、音の反射や拡散、音源の距離による変化など、非常に細かい部分を捉えることができません。

- 音の分散や拡散の欠如: 現実の空間では音が拡散して反射するため、音のエネルギーが多方向に広がりますが、IR はそのような音の分散を完全には再現できません。

- 空間の微細な音響的変化: 空間内での微細な音響的な特徴(例えば、壁の材質や窓の位置などによる影響)は、IR にはすべて反映されるわけではなく、限られた特性のみを再現します。

6. 人工的なエフェクトの混在

IRコンボリューションリバーブは、あくまで録音されたインパルス応答に基づいていますが、これらのIR自体が人工的に処理されたものである場合もあります。録音環境やマイクの影響を受けており、その特性が必ずしも「自然な」空間を再現するわけではありません。

- エフェクトの加わったIR: IR 録音時に、マイクや録音機器の選択によって、意図的にエフェクトが加えられることがあります。これにより、本来の空間の音響とは異なる結果が得られることがあります。

7. エネルギー保存とフレアアップの問題

IR はエネルギーの保存が厳密に守られていない場合があり、これがリアルではない原因となることがあります。現実世界では、音の反響はエネルギーが減衰しながら広がりますが、IR コンボリューションでは、エネルギーの減衰が必ずしも現実的に再現されるわけではありません。

- 反響の増幅: IR が複数回の反響を含んでいると、実際の空間よりもリバーブが強調されてしまうことがあります。これは「フレアアップ」と呼ばれる現象で、リバーブが過剰に強調されることがあります。

この他にも理想的なインパルスを空間で発生させることができるか、AD Converter の問題やサンプルレートの問題も孕みます。

空間と距離が決まっている前提

IR はもちろん、音の加工にも利用できますが、大前提として、その空間での音色が欲しい、という場合に使うもので、もちろん IR からフレキシブルにディティールを変更できるプラグインが多いので自由度もありますが、基本として、空間と音源との距離が決まっている場合にしか利用できません。

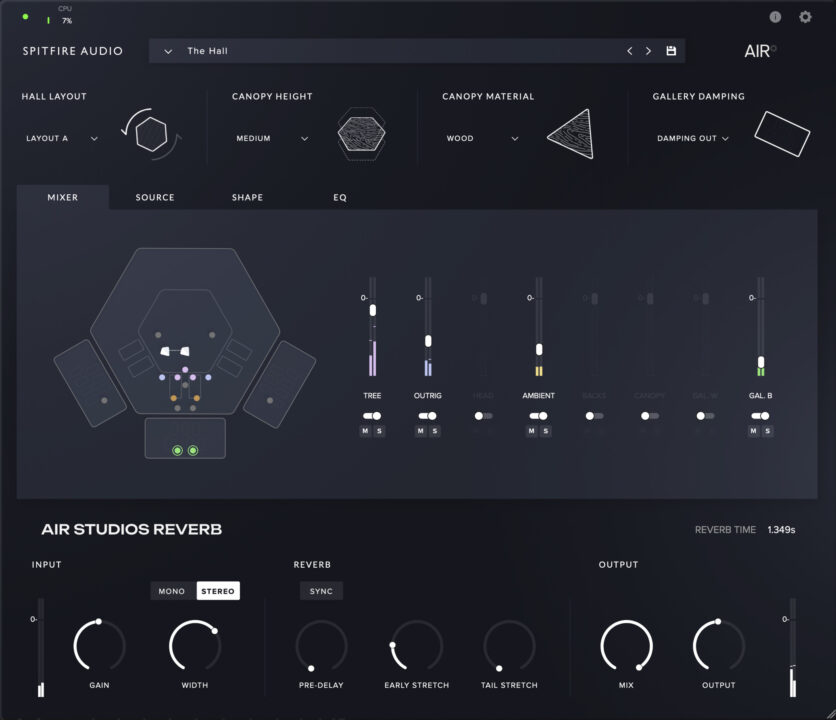

例えば、割と最近リリースされた IR Reverb の最高峰として AIR STUDIOS REVERB があるが、これは一つの空間に絞った IR Convolution Reverb であるため、空間を変えることはできない。

その代わりに 67,000 以上の IR サンプルを利用して非常に高度な単一空間のリアリティを追求している。実際に処理するときに 67,000 ファイルを利用しているわけではなく、キャプチャポイントが多いことに由来する。

そもそもこの IR Convolution Reverb のコンセプトが AIR STUDIOS で演奏したように聴かせるためものであり、どちらかというとエンジニアではなくコンポーザー向けであり、なにかエンジニアがディティールを付加するものではないと思う。いわゆる Virtual Instruments の外部リバーブ的な存在。

IR の原理的にも、もちろん DRY/WET があるので、よくあるアルゴリズムリバーブと同じような感じで利用できますが、IR を利用する Reverb は伝達関数を元信号と合成するものであるため、WET 100% で理論的にはインパルス信号の発生した点とその空間のキャプチャした場所での特性が、完全に再現できます。理論的には。

ですから、IR は「空間の響き」や「空間で鳴った雰囲気そのもの」を表現に付加したい場合に積極的に利用するのです。もちろん、細かなパラメータを設定できる場合は、IR を利用しつつ、新しいアプローチに利用できますが、大前提として、空間とその音をキャプチャした位置 以上の情報付加は難しいということです。

エンジニアからすると、ドライすぎる信号をどこかの空間に置いてあげないと音楽としてちょっと成立しない、みたいな場合には強い味方です。例えばですが、Rock や Punk バンドでどこかの有名なクラシックやオペラのコンサートホールの IR が積極的に使えるか、といわれると、使えないことはないが、積極的に利用できるかと問われると、そうではない、って話です。

AIR STUDIOS REVERB に限って言えば、劇伴などのオーケストラアレンジでは多用できるが、ラップや R&B で多用できるか、は楽曲のアレンジ次第であり、エンジニアが積極的に使える対象ではない、ということ。もちろん、上手に使えばどんなジャンルでも積極的に使えるとは思いますが、そもそも、そういう用途向けの製品じゃないので無理に選択する必要はないということ。

筆者は結局この IR Convolution Reverb の購入は見送った。

以下は Micheal Carnes の言葉の引用: https://www.audiotechnology.com/regulars/last-word-michael-carnes-part-2

畳み込みリバーブの問題はホールのインパルス応答を取得する場合、通常はステージ上の数か所のマイクでキャプチャされたインパルスのみを投影することです。その瞬間にその点音源からそのマイクへの完璧なインパルス応答が得られます。

もちろん物事は変化します。人が動き回ったり、湿度が変わったりします。完璧なインパルス応答があったとしても、2、3 点に収まるオーケストラやバンドを見つけるのは難しいでしょう。それらは空間を占めます。1000 点の放射は控えめな表現でしょう。

マイクの位置から数席移動すると、音はほとんど同じに聞こえますが、インパルス応答は異なります。何が起きているのでしょうか? インパルス応答は何が起こっているかを表す主要な表現ですが、実際に聞こえるものではありません。

十分な数のマイクを使って部屋の周囲の十分な数のポイントから十分な数のインパルス応答を取得すれば、コンボルバー (畳み込み機・ツール) でこれをエミュレートできます。しかし、なぜわざわざそんなことをするのでしょうか。メリットがないのに膨大な計算量になるのです。

もちろん例外はある

私が一番利用する IR Convolution Reverb は LiquidSonics の Illusion です。

これはまた通常の IR Convolution とは違うらしいのですが、少し説明を見てみましょう。

Fusion-IR

この革新的な新しい処理技術は、複数の真のステレオリバーブストリームを同時に処理することで、時間変化するリバーブの進化する特性を捉えます。Convolution ストリームへの入力は変調され、出力は音楽とやすやすと混ざり合う豊かで魅力的な空間に融合されます。

Fusion-IR は通常、Convolution リバーブやサンプルパックではこれまで見られなかったミックスコントロールのレベルのために、別々にサンプリングされた早いリバーブ成分と遅いリバーブ成分も含まれています。

私たちは、LiquidSonics Reverberate 2/3 および Slate Digital VerbSuite Classics 用の Fusion-IR 拡張パックのセットを提供しています。Seventh Heaven および Seventh Heaven Professional 内の Fusion-IR は、プリセットの複数のバリアントを組み込むことによって、リバーブデバイスの多くの次元を再現できるように、コンセプトをさらに発展させています。

Illusion および Lustrous Plates における Fusion-IR 合成は、コンセプトを次のレベルに引き上げ、アルゴリズムベースから合成インパルス応答を生成して、変調された畳み込みエンジンに供給します。

全ては変調にある

インパルス応答はリバーブの単発キャプチャしか提供できないため、モジュレーションのほとんどの利点が失われます。過去にモジュレートされたリバーブをキャプチャしようとした試みは、元のリバーブの多くの認識可能な特性を再現するものの、その真のキャラクターが欠けており、ソース素材と有機的にブレンドすることができない、無生気な再生をもたらしました。元のものを使用したことがある人を欺くことはできませんでした。数年間、畳み込みリバーブはその結果として悪い評判を得てきました。

問題の完璧な視覚的アナロジーは、夜の高速道路で車の動きを捉えようとする写真家の例です。長時間露光を使用して、車両をその進行方向に沿った長い光の筋にぼかすことが可能で、詳細はぼやけますが、動きの効果を捉えます。この効果は、リバーブをトーンスイープするときに起こるもので、すべての変調が貧弱な定義で単一のキャプチャにぼかされます。対照的に、非常に速い露光は、高速道路のすべての詳細を一瞬で捉えますが、動きの感覚を伝えることはできず、翻訳の過程で多くが失われます。

当然のことながら、解決策は複数の写真を撮影し、それらを連続して再生することです。独自のマルチサンプリングインパルス応答キャプチャおよび再生技術のスイートを使用して、LiquidSonics Fusion-IR は、初期の映画の先駆者たちと同じアプローチで畳み込みを行います。

引用: https://www.liquidsonics.com/why-fusion-ir-is-different-from-other-convolution-reverbs/

ちょっと直訳すぎて小難しい話のように聴こえるかもしれませんが、独自のマルチサンプリングインパルス応答と再生技術があるということです。

ここで語られることが、現代のアルゴリズムリバーブの利用についてかなり深いことを言っている。この話がどんどん拡張していくと現代的な使い方の一端を垣間見ることができる。

変調が大事

Reverb と聞くとすぐに距離感だの空間表現だの立体感だの、全くそれらしい、よくわからない、言語化された単語 を聞くことになります。

まぁ、空間表現はアルゴリズムリバーブに於いて、自分で空間デザインをする場合には使える可能性がありますね。例えば、存在しない洞窟のような鳴り、など。それが売りかと思います。

ここで何故 変調 が大事なのか、めちゃくちゃ突っ込んで話をしてもいいのですが、Transient のページで核心的なことを言っているので、それに触れずに、理解されない程度に難解に解説したいと思います。

Lexicon で開発していた元 Exponential Audio の Michael Carnes 氏の話を引用しながら説明します。(Exponential Audio は既に iZotope が買収済で Micheal Carnes 氏は既にこの業界から退く)

Michel Carnes 氏は Lexicon 在籍中に 960L および PCM96 プロセッサを開発し Lexicon のプラグイン開発も担当していた。

彼の Tips を一つ紹介しましょう。

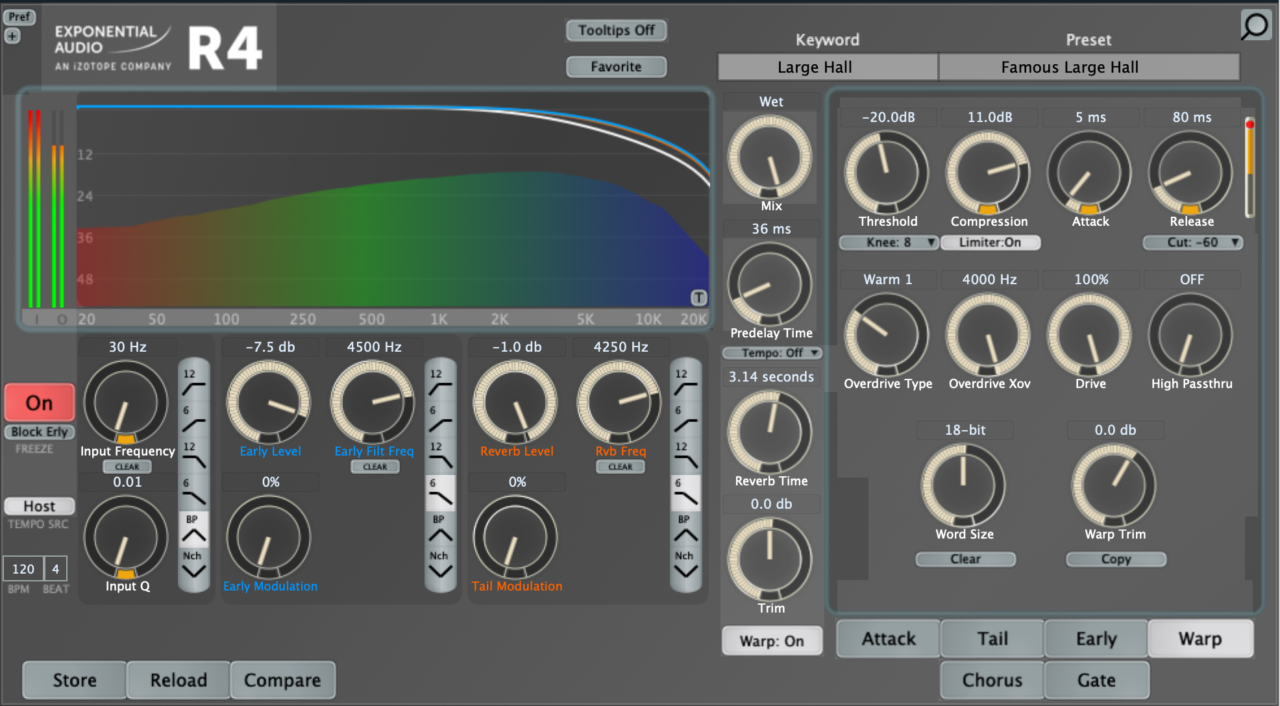

コンプレッサーがあります。静かな部分のリバーブの量を増やすために使用します。とりあえず、スレッショルド値を -20dB に設定してみましょう。ニーをソフトに設定します。必要に応じて自由に変更してください。ここでのポイントは、鋭いトランジェントをキャプチャすることではなく、手動で行うのと同じように、レベルに基づいてリバーブセンドを 変調 することです。ゲインが大きすぎる場合は、ワープトリムレベルを下げる必要がある場合があります。

静かな部分のリバーブレベルを下げてディテールをもっとクリアにしたい場合はどうすればよいでしょうか。Compression ダイヤルを左に回すだけです (マイナスの数字が表示されるまで)。これで入力が減少するにつれてリバーブセンドをカットするダウンワードエキスパンダーになります。

引用: https://www.production-expert.com/production-expert-1/2018/10/2/expert-reverb-tips-amp-tricks-from-the-reverb-maestro-michael-carnes-at-exponential-audio

Michael Carnes 氏はポイントとして音量の変調要素を上げている。実はコンプレッションは音量を圧縮する行為 (レベル差をなくす要素) と捉えられがちですが、ここでは Reverb の音量を変調する、という視点の解説がある。要は「コンプレッサーは変調を付加できる」という さらなる応用的な視点の考え方 が重要である。

ちなみに私はこの話の応用として Reverb に入力する前の波形変形について、Transient の記事 で語っている。

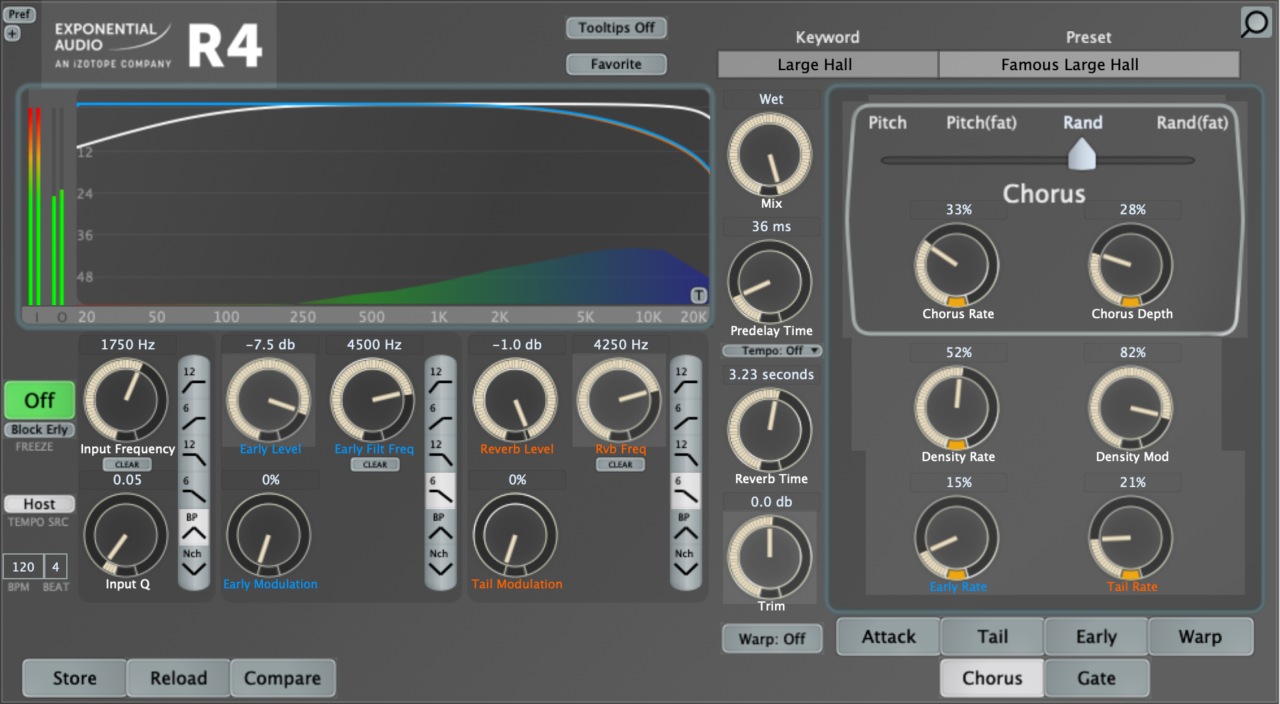

リバーブのコーラス効果は、もともと初期のリバーブで不快な共鳴や部屋のモードを減らす方法として設計されました。コーラスは、LFO 制御のピッチシフトをリバーブテイルに導入することで機能します。リバーブデザイナーの間ではあまり好まれませんでしたが、初期のリバーブは処理パワーが限られていたため、必要な妥協策でした。しかし、ミキサーは気にしませんでした。彼らはモジュレーションの効果を好み、これは 80 年代と 90 年代のミックスの定番となりました。

コーラスはもはや必要ありませんが、ミキサーは依然としてこの効果を好みます。微妙なものから吐き気を催すようなものまで、ピッチ変調による明らかな変調は依然として利用可能です。コーラス ページにアクセスすると、興味深い「Fat」というラベルが付いた 2 つのオプションが表示されます。Fat モードはコーラスを駆動し、ピッチが同時に上下します。結果は予想外であり、ピッチ効果は非常に検出しにくくなります。代わりに、リバーブはより太くなります。

引用: https://www.production-expert.com/production-expert-1/2018/10/2/expert-reverb-tips-amp-tricks-from-the-reverb-maestro-michael-carnes-at-exponential-audio

他にも Lexicon のハードウェアリバーブの演算パワーが足りないためにアルゴリズムをモジュレーションを駆使して設計した話や、初期反射が少ない理由も演算パワーがなかったことに言及しています。

Chorus 要素は、明らかにリバーブで連続的な要素が必要であるが、それに伴う不要なフィードバック要素を減らす Comm Filtering を実装していることは Delay の応用を知っている人ならすぐに理解できるだろう。以下の「狂ったように鳴り響く」という表現はフィードバック現象 (ハウリング) のことを指す。

「Lexicon サウンド」には特定のアプローチがありました。その多くは、貧弱なハードウェアプロセッサでリバーブを作ろうとしたときに生じるアーティファクトを回避することから生まれました。

最も遭遇した問題はルームモードでした。再循環ディレイやさまざまな古いトリックを設定しましたが、積極的に管理しないと、狂ったように鳴り響きます。私の前任者である David Griesinger は、基本的に音が悪くならないようにするための多くのトリックを考案しました。それが「Lexicon サウンド」でした。変調、小さなピッチ効果、その他さまざまな奇妙な現象が聞こえました。

80 年代や 90 年代にミキシングをしながら育った世代にとって、こうした人工物はサウンドの一部になりました。ほぼ全員が「それが自然で、深みがある」と言うでしょう。これほど真実からかけ離れたことはありません。実際のホールに行っても、そのような音は決して出ません。

引用: https://www.audiotechnology.com/regulars/last-word-michael-carnes-part-1

この部分から、如何に Reverb に 変調要素をエンジニアが適切に音楽に適応していくのか、を 私は 考え始めました。また、初期反射について真剣に考え始めました。

現在は開発が終了している Exponential Audio の Reverb 郡ですが、Early Reflections の項目をかなり自由に操作できる点で、狙った音にかなり近づけることが可能になりました。より、部屋っぽさを IR やその他のアルゴリズムリバーブより直感的に操作できるようになりました。

初期反射

初期反射、Early Reflections については、Reverb の会話の中でよく出てくる単語ではありますが、それを制御したらどうなる、という感覚が非常に難しいです。

特にアルゴリズムリバーブの難しい点として、Pre Delay、Reverb Time、Early Reflections、Diffusion、Size やそれらに対するもう少し細かい設定や Filter 設定など細かな設定を要求されることです。

おそらくほとんどのユーザーはプリセットを利用していると思いますが、私のようなエンジニアは自分が求める挙動のために各パラメータが何に作用するのか把握して微調整を繰り返します。

この作業が明らかに難しいため、Reverb を説明することが困難となる要因となります。

ここ 20 ~ 30 年でレコーディングが大きく変わったことが要因です。当時はホームスタジオやプロジェクトスタジオが始まったばかりで、ほとんどのレコーディングは良いライブルームのあるスタジオ(または実際のホール)で行われていました。そういった場所の音はたいてい良く、初期反射はそれぞれの場所の特徴的な音でした。エンジニアは無指向性のマイクをより頻繁に使用し、それらのマイクは良い空間のあらゆる側面を捉えていたので、初期反射セクションは通常不要でした。私が手がけた Lexicon リバーブは通常、チャンネルごとに 1 つか 2 つの反射しかありませんでした。それらは役立つこともありますが、バックスラップや「効果的な」種類のサウンドを作成するために使われることが多かったのです。

時が進み、現在ではレコーディングの世界は完全に変わりました。私たちの多くは小さな部屋で作業し、時には処理を施したり施さなかったりします。部屋には演奏者が 1 人だけのシングルトラッキングが増えています。シンセとサンプルライブラリからオーケストラ全体を作り上げることもあります。そして、ノイズの多い世界では、指向性マイクがますます求められるようになりました。何らかの助けがなければ、これらの録音は、優れたビンテージリバーブを使用していても、耳障りで無機質に聞こえてしまいます。優れた初期反射のセットは演奏者をマイクから遠ざけ、その録音をリバーブテイルにつなげるのに役立ちます。また、録音が個々のトラックから構築されている場合でも、他の演奏者からのマイク漏れの感覚を作り出すのに役立ちます。

引用: https://www.fast-and-wide.com/more/fast-talk/10839-interview-michael-carnes

Early Reflections の項目や Reverb の Attack 要素に対してかなり積極的に介入できる Exponential Audio のプラグインは個人的には非常に画期的でした。

アルゴリズムリバーブはドライシグナルに対してリバーブ成分を AUX 経由で混ぜる、ということがかなり基本的に利用されてきた。

つまりは、ドライ信号にリバーブ成分が追加されるだけで、実は「距離的な表現は直接的には変化しない。または 間接的に変化しているように錯覚する場合がある。」であり、これは原音に対しての干渉具合 (インターフェア) で変化する。

ここである程度初期反射について誇張表現が可能である場合、原音に積極的にインターフェアしなくても残響の手がかりを視聴者へ印象強く与えることができる。その最たるものが距離の表現に重要な Pre-Delay でもある。

重要なのは、我々は距離や空間というものはすべてが音響心理の錯覚によって感じているという事実を自分で受け止めて、理解と納得をするべきだということ。

例えば、スピーカーやヘッドフォンで視聴している場合にもかかわらず、自分が動かなければ音の発生位置や耳の鼓膜などの聴覚器官の位置は同じなのに、何故「聞こえる音が遠くにあるような音に聞こえるのか」という自問自答と音響心理学の基礎知識を使うことだ。

当たり前だが、人間は音は骨伝導や鼓膜や聴覚細胞で感じるが、遠い音であろうが、近い音であろうが、例え、スピーカやヘッドフォンの視聴の場合でも発音位置と人間の感覚器官の位置は人が動かなければ絶対に移動しないし、これは録音における楽器とマイクの位置と同義で考えることができる。

にも関わらず距離感だのの話になるのは非常に矛盾しているように私は感じる。スピーカーは動いてないのにどうやって音が近くに聴こえたり遠く聴こえるのか。それは、近い音はどんな特性を持っているから近いと感じるか、遠い音はどんな特性をもっているから遠く感じるのか、それ以外の情報は実は必要ない。

音は空間表現では音源の位置は動かない、という事実を理解した時に「音の奥行き…立体感とは…?」という感情を持つべきである。もちろん、奥行き という言葉は対比があれば使える。ただし、立体感とは…なにを指す?

室内音楽の場合は空間の響き自体が「音楽を形成する要素」に影響するのですぐに「空間表現」という言葉に流れてしまうが、障害物のない平地の原っぱを想像して、近いとか遠いを再現しようとすると、空間とか距離感とか、全く役に立たない言葉であることが言える。重要なのは音響特性の時間変化である。

残響は広がりを感じるファクターであり、立体感的に聴こえる要因だ、などと言うが、実はそんなことはない、という話は既に Transient の有料記事 で解説している。

広がり自体の表現は単にステレオの位相差であり、立体的に聴こえるかはさておき、Mono 信号にステレオリバーブを付加するとステレオ感が得られるのは LR 間の位相差と周波数の時間変化が残響で付加されるからである。

そして、ここで Reverb を Mono で生成した場合、ステレオの位相差は発生しないため、「広がり」という言葉の部分では全く音は広がるわけではないため、Reverb が必ずしも「広がりと関係がある」とは言えなくなる。

もちろん、私は距離感の正体について、明確に有料記事で語っているので、そちらを参照されたし。

実は Reverb を多く足していくと残響が深くなり、そして立体感のために遠い音を表現する、というアプローチにはステレオ感は逆に狭くする必要があるため、みんながよく言う立体感だの距離感だのっていう表現言葉の実態は Reverb 以外の別の要因のほうが大きいんだ。

リバーブは遠近感ではない (外部リンク)

初期反射の制御が難しかった昔のシステムではショートディレイを上手く利用していたのだと思う。もちろん当時のサウンドのエンジニアが工学的な視点を内包して利用していた、とは思いませんが、ショートディレイにエフェクトをかけたり歪ませたり、極端な EQ を施したりなどの古典的なアプローチは存在する。今でも複数のショートディレイを利用するエンジニアはいるでしょうし、それは複雑な初期反射の簡易的な再現にもなるでしょう。

もちろん初期反射はショートディレイとは異なりますが、似たような効果を得られる場合があり、それがディレイとは異なり、かなり自然にドライシグナルと混ざるところが重要であると個人的に考えます。

基礎の話をしておく

ここまで、読者を置いてけぼりにして一方的に Reverb について言及してきたが、基礎的な「残響」の話をしておく。

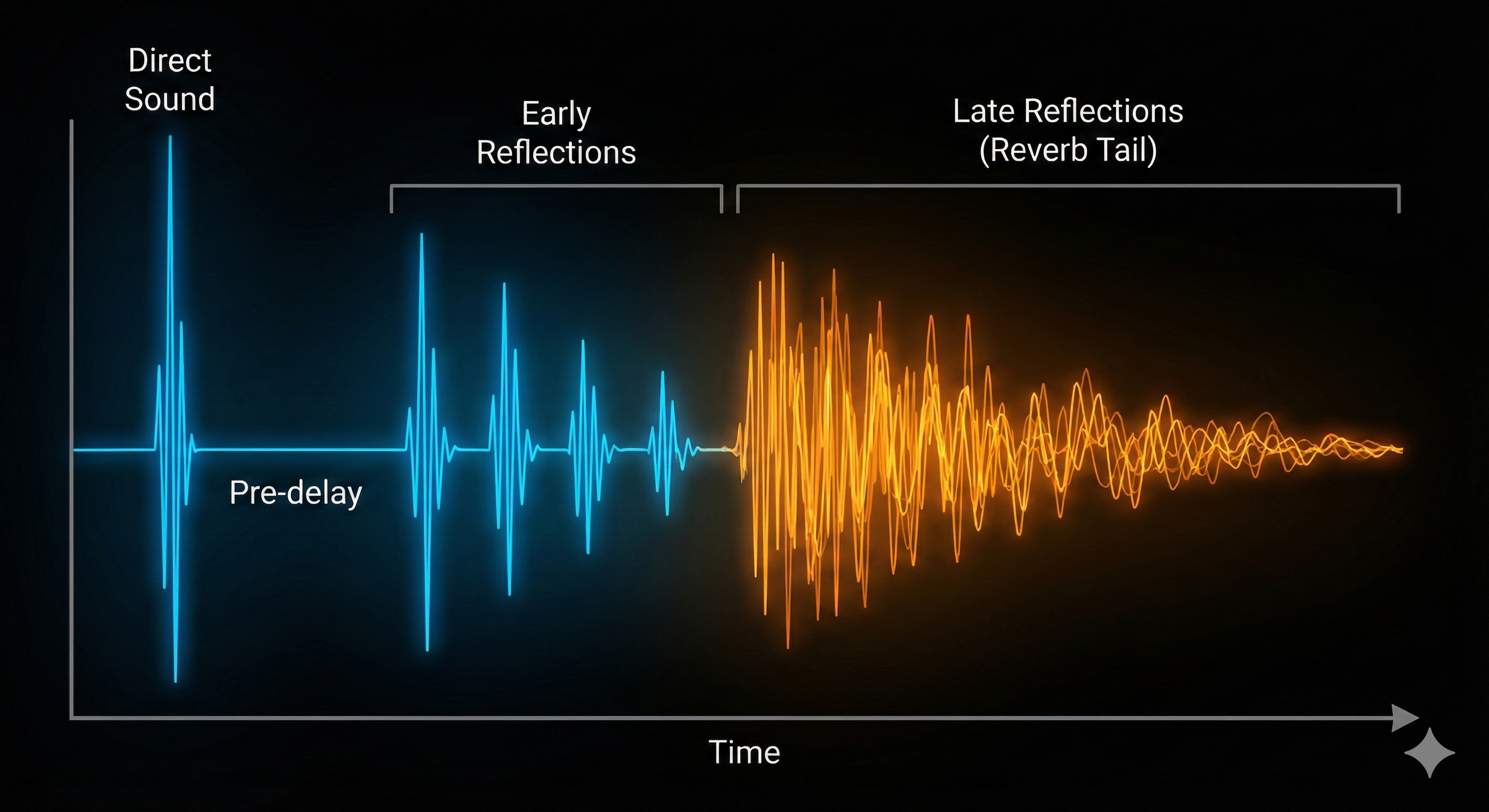

画像を見てほしい。(AI に作らせたがやべぇな。)

Reverb のプラグインの大多数が、Pre-delay の設定した ms に応じて「Early Reflection」初期反射が生成されて、その後にアルゴリズム的に「Late Reverberation」後期残響が発生することが基本である。つまり、よくある Reverb というのは「Early Reflection + Late Reverberation」がセットである。

もちろん、いくつかの Reverb Plugin では、そもそも Early Reflection が発生しないものあるし、Early Reflection の詳細な設定項目がなく、Pre-delay が Late Reverberation のみに有効なもの、などなど、実はプラグイン側の設計の問題で「Pre-delay が音の前後を決めるんだよ」とか言う説明が当てはまらないプラグインも非常に多い。

そもそも Early Reflection に Pre-delay の値を適応出来ない場合、初期反射の発声が非常に早く、そして間隔が非常に短いアルゴリズムがあったら、いくら Pre-delay を設定しようが、Early Reflection はすぐさま聴こえてくるので、よくある距離感みたいな表現をされる処理がそもそも無理じゃね?っていう状況はあるからだ。(もちろん別の回避策はある)

ですから、実はプラグインごとで「Pre-delay が何に対して発声を遅らせるのか」という部分をしっかり把握しないと高度な Reverb 利用は難しくなってくる。もちろん、私は理解するためにはこれらの事象をしっかりと理解しなくてはいけないとは思うが、使う側はセンスでなんとなく使えばいいし、プリセットを使っていけばいいと思うが、説明として統一できないから解説している、という事実をここでは念押ししておく。

基本的には Pre-delay は全体の発声遅れ、と捉えてよくて、最初の「Delay のような Early Reflection」が生成されてそのあとにアルゴリズムの Late Reverberation が生成されます。基本的には「初期反射と後期残響はセット」で考えることが多いです。そうしないと空間の再現という部分では矛盾をはらむ場合があります。

ただ、最近のプラグインだと、Early Reflection の Pre-delay は制御できないことが多いかな…大体「Late Reverberation」後期残響が生成されるまでの時間が Pre-delay であることが多いです。ただ、まじでプラグインごとで違うので 議論が難しくなる原因となります。

ですから、Reverb 全体の遅れなのか、Early Reflection の Pre-delay なのか、Late Reverberation の Pre-delay なのかの把握は実は重要だったりします。もちろん、どちらも制御できるプラグインもあれば、アルゴリズム側で「Pre-delay は Reverb 全体の発声の遅れ」の場合もあるし「Late Reverberation のみの遅れ」の場合もあります。

ややこしいし、難しい原因だね。

Pre-Delay の役目

ここは非常に重要な要因になる場合がある。

単純な工学的な視点から言うと Pre-delay は「空間の奥行き」を決めるような値ではあります。ただし、これはあくまで「シミュレート上の空間の奥行き」であって、音に奥行きを感じるか、とは少々異なるのです。簡単にいうと他にも情報は必要だって話。

直接音とのインターフェアを考える場合、Pre-delay はない方がいいと考えるべきシチュエーションもあるのだけど、それは多少多角的に見る必要性が考えられる。というか Early Reflection のエンベロープがどうなっているか、という話もできる。

重要なのは Pre-delay は簡単に言えば初期反射の到達時間なわけだけど (もちろん各機材やプラグインでも考え方が異なるし、Pre-delay を Reverb Time と Ealry Reflection で個別に設定できるものもあるし)、これを遅くすればするほど、直接音の Transient 要素には介入しない、ということになる。もちろん、介入しないのは最初の初期反射のみであり、深すぎる残響がある場合、残響が Transient にインターフェアするし、逆に連続した音の立ち上がりの間隔が早すぎる短すぎると、初期反射が次の Transient にインターフェアする場合もある。

これに関連して Reverb には Ducker がついているものがあるため、少し複合的に理解する必要があるので、初期反射と密接なつながりがある。ぶっちゃけ、初期反射がとても少ないものであれば Pre-delay はあまり考慮しなくても良くなり、残響のみを扱うような Plate などには Pre-delay は必要ない、とまでもいかないが、なくても良いシチュエーションが考えられる。

Pre-delay はただ単に「Reverb 成分の合成をただ遅らせる」という行為を実行するだけで、Pre-delay がなにか特別な処理を実行しているわけではない、問題は音響心理学に発展する。実は単純に周波数が変化した遅れた音が聴こえるだけで、人間は過去に聴いた音に対して錯覚を起こす。

これは非常に面白い効果で、人間は現在聴いている音の傾向で過去に聞いた音の心理的な感覚が錯覚するのである。ですから単純な Delay + Feedback でも距離感、とか空間表現、みたいに言われる音の錯覚を起こします。

初期反射は大事であるのだけど、大事だからこそ「無し」の選択肢を取れるか、は大きい。

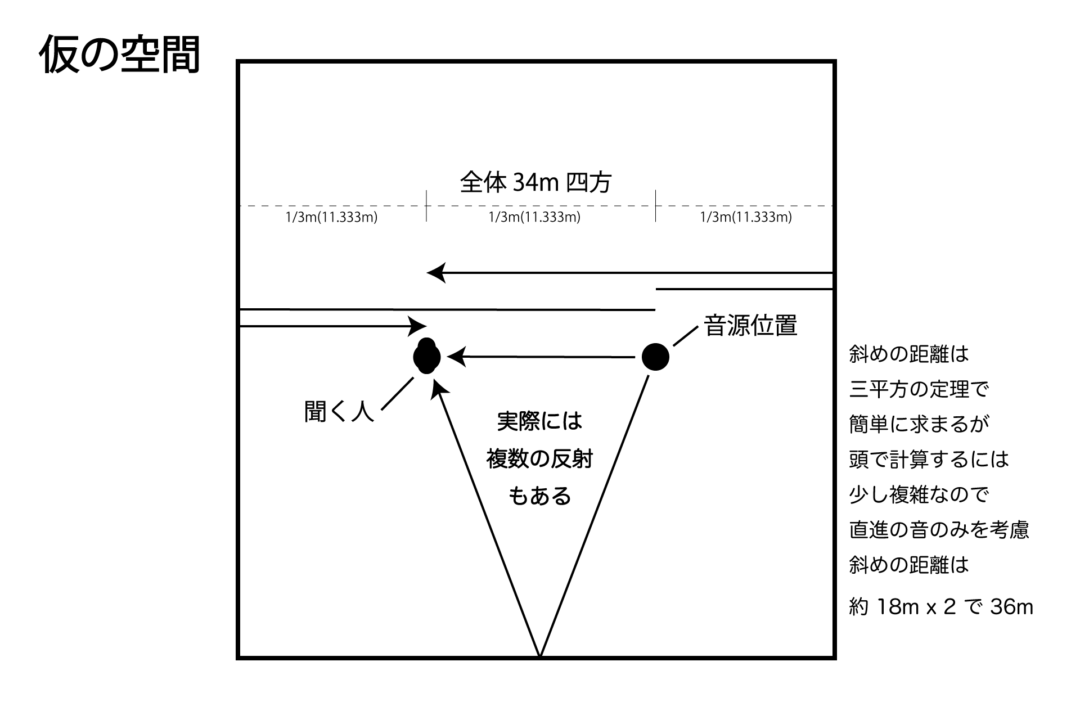

部屋っぽさを極力演出したい場合や、音源の大きさ (音の大きさではなく音源の巨大さ) みたいなものを扱う場合は、部屋のサイズを大きくして Pre-delay の値も、部屋のサイズに合わせて調整しないと、かなりチグハグなリバーブの音になるので、ここでは 非常に短絡的な意見として Pre-delay 値の暫定的な設定方法を解説しておく。

ちなみに Atmos Mix をするときに Size というパラメータがあり、その表現に近いのが音源の大きさ、みたいな感覚です。

わかりやすいように部屋のサイズを 34m とした。音は 1 秒間に 340m 進むと仮定する。ちなみに音は実際には空気密度と温度で進むスピードが変わるが、標準大気 (1気圧) で 331.5 + 0.61 t であり、340m はざっくりとした値ではあるが、暫定的な数値を決めるのには十分すぎる定数である。

34m の部屋の端から端までは、約 100ms で到達する。つまり初期反射が音源から元の位置まで約 200ms で戻って来るわけだけど、リバーブはそういう空間を表現するわけではなく、音源が基本的には 34m の空間の中心で発生した音を再現するような作りであるため、その半分、17m で反射する。そして音源位置に戻ると仮定するので、Pre-delay は一旦の暫定値として 100ms でいいと思う。

もちろん、部屋の端から端であれば、初期反射は限りなく 0 ms で単純な直接音は 100ms 遅れるので初期反射は遅れない。ただし、直進方向の音のみを考えた場合であるが。初期反射の Pre-delay なのかリバーブ全体の Delay なのかで、考え方が少し変わってしまうのがアルゴリズムリバーブの使い方の難しいところ。Pre-delay は基本 Reverb 全体の遅れであるから。

実際には「どこで聞くのか」の問題も孕むので、楕円の 2 点 を考えたりすると、11.333m 間隔で音源と初期反射を聴く位置を決めたりすることもできるので、11.333m で直接音が聞こえて 34m で初期反射が返ってくることも想定できる。つまり初期反射は 100ms、直接音の遅れは 1/3、つまり 33.333ms である。

ただし、33.333ms 遅れる直接音だって Dry シグナルとは特性が異なるだろうし、直接音から遅れること 22.666m 進んだ音が初期反射のため、初期反射は 66.666ms の遅れとも捉えれられる。実際には Pre-delay の値をここまで遅らせる必要もないかもしないが、部屋の大きさに合わせて暫定的な Pre-delay 値を与える目安にはなる。

このあたりは暫定的な Pre-delay を考えるためのメソッドであり、それが正しい値であるかどうかは関係ない。あくまで部屋のサイズに合わせて暫定的な値を求めるメソッドであり、実際のリバーブで複合的な距離の問題を解決することは困難である。単純化して考えなければいけない。もちろん、数値はもっと短く見積もってもいいし、長く見積もってもいい。微調整自体は己の感性との戦いである。

ただし、初期反射をこのようなメソッドで利用すると、急に求めていたようなリバーブの質感に限りなく近づく事が多いため、利用できる場合がある、と覚えておくといいかもしれない。

残響と初期反射は実は結構難しい関係にあることはこの思考実験からも理解できるだろう。

エンベローブ介入

つまり、Transient へのインターフェアが起これば起こるほど、直接音が曖昧になるため、音の明瞭度というか、フォーカス具合をぼかす事ができる。ドライすぎる音は実は点に聞こえて、最終的には頭蓋骨、頭の中でなっているような音に聞こえてしまうため、これを回避するために、環境音が複合的に混ざると、人間、距離というか、音の位置を錯覚することができる。

音源やシチュエーションによるが、部屋が広い場合、Pre-delay 値は大きくなるだろうが、直接音が強いため奥行きの表現が難しいと短絡的に理解出来る。もちろん、そもそも残響音を認識しづらい音だと奥行きが感じづらく、残響音が認知しやすい音の場合、残響の認識時間の影響で距離や奥行きや立体感と呼ばれる Pre-delay とは別の要因で得られる効果の知覚が強くなる。

この理解があれば、大きい部屋を再現するときに、 Reverb time は極端に短くても、Ealry Reflections を誇張表現できれば、残響を制御しなくても大きな部屋として錯覚させることは容易である、と考えつくだろう。そして Pre-delay の値で音源の位置を多少、前後させることはできる。

よくある「大きい部屋 = 残響が長い」という 固定概念がここで崩れる。

これを距離感という人がいますが、距離感はあくまで相対的な A と B の距離の間のことなので、距離感ではなく、距離、音源の発生源の位置、という表現ではあります。2Mix の場合は基本的に前方 180 度の間の表現になる。(もちろん位相を複雑に組み合わせて後ろの音を作ることはできるけど、ヘッドフォン視聴またはバイノーラル前提であったりなど。)

あくまで、距離感とは言葉の問題ではあるが、リバーブは距離感を創造はできない、あくまで視聴している人と音源がなっている位置の距離を錯覚させることであったりするだけで、距離感の演出は実はもっと複合的な リバーブ以外の制御も大事 になるということだ。

重要なのは直接音と Reverb 成分の関係性でどのような音響工学的な効果が考えられ、そして音響心理学的にそのような効果の音はどう人間が錯覚するか、を常に考え続けなればいけない。(めっちゃ難しい。)

もちろん、距離感や立体感というようなものを錯覚させるためにある程度調整ができる高性能な Reverb もあるのですが、基礎的な Reverb の動作では非常に難しいため、他のツールと併用していかなければいけない。確かに Reverb だけで距離や立体、を錯覚させることはできるのだけど、効果が薄い、対比が極端にないと表現として非常に薄い、と捉える必要がある。他のアプローチと複合的に利用して、もっと誇張的に距離感や立体感を大幅に錯覚させないと 2Mix の場合はその対比を視聴者に効かせることが難しい。

大きい音はどうしても遠くには配置できないため、Reverb だけでは大きくて遠い音の再現は無理だ。重要なのは「遠い音はどのような音響特性を持つか」や「音は時間経過でどのような特性変化を起こすか」である。

また、Pre-delay や Ducker を駆使する場合、直接音にインターフェアする音が減るため、逆に距離を錯覚させる事象は減るので、よく語られる距離感を作る行為とリバーブの実際の動作は実は相反することをしている。

だって、みんな Reverb は欲しいけど、歌を邪魔する Reverb の音を Masking 対策で削ったりするじゃない、それって本来の Reverb の本来の動作を薄くするものだよね。すでに現代では真逆のアプローチが主流になっているのに、音響心理学の揺るがない事実とは真逆の言葉、距離感、奥行き、立体感、という謎の言葉を使っているんだ。正直、奥行きとか立体感ってなんやねんって思う。(答えは Transient の有料記事 を参照ください)

もちろん、瞬間的な制御を組み合わせてることによって Pre-delay が直接音とインターフェアしないからこそ、距離感や立体感の誇張表現が可能になる場合も非常に多いので考え方が難しくなる。

もちろん、Early Reflection と Late Reflection の時間変化の影響が非常に大きいので、Pre-delay が距離感を司るパラメータである、というのは間違いじゃないんだけど、本質的な答えではないということ。当たり前ですが、Pre-delay を上手く使えば逆に元の信号に対して距離感というものを極力与えずに、音がもっと逆に飛び出してくるような音も作り出せる、ということです。もちろん、複合的な処理が必要でもあると思います。

まぁ、これはミックススタンスみたいな話に派生してしまうが、Reverb はあくまで表現の一部で、歌は直接的な音がよく聞こえたほうが、耳馴染みというかオケ馴染みが逆に悪くなって、歌とその他の音の対比ができて歌が聞き取りやすいとか、全然空間とかオケ馴染みとは真逆の方向性を持った処理になるんだけど、実際の感じ方はオケに馴染んでいると錯覚する、処理と感じ方が乖離する典型というものでしょう。

だけど、この話は別角度から説明することができ、他の音とのエンベローブや音の減衰の仕方が異なると、楽曲としてバラバラの Release を持つため、リズムが悪く聞こえたり、音源のちぐはぐさを感じる原因となる場合があるので、Reverb 使う、という典型で、これも空間表現とか距離感とか立体感などとは 全く異なる概念 であることが理解できると思う。他の要因のほうが実際の得られる感覚の影響が大きい典型である。

要は、楽曲に合わせた表現であり、よくわからない 抽象的な表現で語られる謎の感覚 は捨てたほうがいい。

実は変調要素は割とスタンダード

日本の情報では全くと言っていいほど、Reverb の変調要素について語られません。

何故かというと、こういう背景を語れる人がいないから、一択だとは思っています。

また、空間表現の行き着く先 = 空間の再現 のような価値観があります。その弊害でしょう。重要なのは音楽に適切だと思う表現の付加であって、ぶっちゃけ空間の再現は音楽ではあまり重要ではありません。もちろん、アプローチの側面から、その限りではないのですが。

少し極端な例

例えば、とあるセッションでドラムは Studio A で録ったけど、ストリングスアレンジは Studio B で録りました、となった場合に両者の部屋というかスタジオの音は異なります。実際には別に両者の部屋鳴りの音が違ってもなんら問題はないのですが、ボーカルはデットな部屋で録音した場合、両者の部屋鳴りに合わせた Reverb が必要だと、考える場合があります。

もちろん、デットそのままの音でもいいと思いますが、作品の「パッケージ力」という言葉を私はよく使うのですが、全体の統一感だったり、質感のある一定方向への統一、などは必要な場合が多く、この場合には正解がどこにあるかはわかりませんが、近道として、ドラムとストリングの部屋に近い残響がマッチしそうだ、とある程度経験的な想像ができます。

こういう場合に、エンジニアの頭の中にある、特定のバーチャルな Reverb 空間をソフトウェアリバーブ上で構築する必要があります。この場合には頭で想像する個人的なリアルな空間再現はミックスの近道として役に立つ可能性があります。

もちろん、すべてがそうではありません。方向性が違ったら間違いです。

重要なのは変調という部分

ここでは Reverb よりも変調要素についてフォーカスしていこうと思います。

ダラダラ書き連ねるのも、読者にとって早く結論言えや、って感じだと思うので、正解というか、答えというものはつまり、Delay をどう応用を効かせるか、になります。

この話は、いずれ delay の項目を書く予定なので突っ込みませんが、基本的なことだけ羅列します。

Delay の記事はおそらく 5 年とか 10 年とか書くまでに時間がかかるかもしれません。今書いてもただ、応用を羅列するだけでつまらないので。

Delay と応用

ぶっちゃけ、知ってるわ! って話になる方もいるので、ここでは知識として把握しておくだけでいい。

これをリバーブに応用していくのは結構至難の業でもあり、そういう最適化は Reverb 作った人が行っているはずであり、重要なのは ソフトウェアリバーブ のパラメータ項目をちゃんと理解して使うこと、である。

以下は触りの知識として覚えてほしいことで、あとは自分で拡張していってくれ。

Delay と LFO

この話ですべてが片付いて欲しいのですが、変調と言ったら、LFO 絡みだと思ってください。

LFO は Low Frequency Oscillator の略です。

Delay と LFO を利用するといろいろなエフェクターの基礎構造がわかります。

以下は AI の回答を羅列するだけですが、ミックスで変調を多用するきっかけとして覚えておいてください。

コーラス (Chorus)

Delay と LFO を用いて、わずかなピッチ変化とモジュレーションを加え、音に厚みを与えるエフェクターです。

- Boss CH-1 Super Chorus

- TC Electronic Corona Chorus

- Electro-Harmonix Small Clone

フランジャー (Flanger)

短い Delay と LFO を使用して、独特の「ジェットエンジン」のような効果を生み出すエフェクターです。

- MXR M117R Flanger

- Electro-Harmonix Electric Mistress

- Boss BF-3 Flanger

フェイザー (Phaser)

Delay とは異なる位相シフトを LFO でモジュレートし、渦巻くような効果を作り出すエフェクターです。

- MXR Phase 90

- Boss PH-3 Phase Shifter

- EHX Small Stone

ヴィブラート (Vibrato)

Delay と LFO を使用して音程を周期的に揺らすエフェクターです。

- Boss VB-2W Vibrato

- TC Electronic Shaker Vibrato

- EarthQuaker Devices Aqueduct

トレモロ (Tremolo) + Delay

LFO による音量の周期的な変化に、Delay が加わる場合もあります。

- Strymon Flint

- Boss RT-20 Rotary Ensemble (ロータリースピーカーのシミュレーションにも使用)

テープエコー (Tape Echo) のモジュレーション機能

テープエコー系の Delay には、LFO によるモジュレーションが搭載されているものがあります。

- Strymon El Capistan

- Roland RE-201 Space Echo

- Boss RE-202 Space Echo

モジュレーションディレイ (Modulated Delay)

Delay エフェクトに LFO でモジュレーションを加えることで、揺らぎのある Delay サウンドを作り出すものです。

- Eventide TimeFactor

- Strymon Timeline

- Boss DD-8 Digital Delay (Modulateモード)

ユニヴァイブ (Univibe)

LFO と Delay を組み合わせて独特なコーラスとフェイザーの間のようなサウンドを作るエフェクターです。

- Dunlop Uni-Vibe

- TC Electronic Viscous Vibe

- Fulltone Deja Vibe

これらをミックスで多用していく意味を考えると、Reverb 以外でも Delay と LFO の組み合わせエフェクトを利用する意味を見いだせる。

やたらめったら Reverb を使うのではなく、Reverb の思考の前か後に Delay と LFO のエフェクトを考えてみることで、逆にリバーブを多用することをかなり避けられるアプローチが得られる場合がある。

ある程度、音響工学や音響心理学の知識がある人は Comm Filtering が如何に人間にとって空間や音を錯覚させる要素であるか、というものがわかると思う。この部分は非常に短絡的な工学的な視点で厳密に正しくはない部分はあるものの、昔から空間系のエフェクトといえば、なぜか Reverb ではなく、Delay や Chorus などのエフェクターを指していたでしょう?

特に困ったら Reverb という手法はよく見られるため、Delay と LFO の応用を効かせたプラグインを立ち上げるほうがよっぽど効果的な場合があるということでもあり、Reverb の Tail にこれらのエフェクトを足してみるアプローチが非常に大事だと思う。

理解できないパラメータ

個人的にはこれにつきます。

一つずつ、ちょっと見ていこうかな、と思いますが、自分が使う前提で話しますので、直接役には立たないことを前もって伝えておきます。ただし、思考方法がわかればどんな Reverb でも応用が聞きます。

毎度ながら言っていますが、知識を得て、それを利用して試行錯誤するのです。それは求める音への近道になる可能性があります。別に誰でも仕入れなくても良い情報だとは思いますが、利用すると欲しかった音への到達スピードが段違いになります。

Reverb One

Pro Tools の標準は割と使えるんだけど、使わないのは UI の問題やパラメータへの深い理解が無いからである。

やはり標準でも Early Reflections と Chorus のパラメータがある。ただ、初期反射とコーラスというパラメータだけを見ても全く要領を得なかった人がたくさんいたと思うが、この記事をしっかりと呼んで一つずつ真剣に理解を深めてきた、上位 1% 未満の人はこれらを有効に使える人になるだろう。

青い枠の部分は Reverb のパラメータのレベルであり、これを -INF (無限小) にしてしまえば、Early Reflections のみの音を聴くことができて調整もできるんだ。

ちなみにこの Reverb One は Plate とか Room とかのアルゴリズムがあるように見えて、Early Reflections のパターンがあるだけである。初見で理解するのは非常に難しい。実は Early Reflection の音はアルゴリズムで変化するけど、Late Reverberation の音はアルゴリズムを変えても変わらない。

つまりは、空間のシュミレートパラメータにただ初期反射のパラメータを追加しているだけというアルゴリズムリバーブになっている。うーん、パラメータを理解するとなんか Reverb って 非常にチープな作りをしている ように感じてくるだろう?

Revibe Ⅱ

こいつは結構自由度が高くて使えるんだけど、使い方を知らないと、そもそも応用も考えづらい。

こちらも Early Reflections と Room Coloration、Levels、Chorus というパラメータがある。このプラグインは Reverb の Pre-Delay と Early Reflections の Pre-Delay が個別に設定できるのですが、あまりパラメータを触りたくない人向けに LINK のボタンがある。ただし、この記事を読んだ諸君はこの LINK ボタンがどれだけ いい加減なボタン であるか、理解できただろう。

こちらは Reverb のプリセットというかアルゴリズムを選択する。これは 200 くらいのアルゴリズムから選択する必要がある。だからプリセットぽちぽち系である。

これはアルゴリズムでかなり出力の音が変化するため、使いこなすのは ほぼほぼ 難しいレベルにはなるのだけれど、たくさん選択ができるという利点と取ることもできる。

大体、Short Delay の設定ってどうしたらいいかわからないことが多いと思うんですが、このプラグインは Early Reflections だけを適応することができるので、Reverb の Level を -INF に設定して、Early Reflections を ON、そして これは Levels という項目があって、そこで微調整もできるんですが、プリセットを切り替えていくと、楽曲にマッチするかかりをするものが見つかる可能性がある。

ちなみに Room Colorations である程度のトーンバランスの調整ができるんだけど、超絶 Cinematic な表現を付加したい場合は上記の図のような設定が生きる。

これは極端な言い回しをすると Early Reflections の EQ みたいなものなのだが、かなり極端な設定は名盤というかよく聴衆する音に近くなる傾向がある。

ILLUSION – LiquidSonics

この Reverb はですね、結構便利なんです。ただし激難ですよ。

この子は自由度というかパラメータが多岐にわたるのでめちゃんこ難しいのですが、すべてを把握すれば、マジで思い通りの挙動を再現できます。

重要なのは Early Reflections だって言いましたが、この子は Early Reflections に独立した EQ を施すこともできますし、真ん中のパラメータ表示は Early Reflections の挙動を表示しています。

いちいちプラグインの挙動をさらうことはしないけど、こいつは Early Reflections のパターンを色々変えることができるので、明確なビジョンを持って触りにいかないと、Reverb が決まらない、という典型になる。

ILLUSION は初期反射が大事って感じのプラグインで、そもそもそこにフォーカスしたような Reverb なので、今までの説明をすべて理解した上で触らなければならない。そりゃ、Reverb 教えられないよ。普通の人は。ムズすぎ。

例えば、あんまりやらないけど、Early Reflections と Reverberation を並列処理で分けて、それぞれ別の処理を追加で掛ける、なんて言うこともできなくはない。初期反射をもっとひどく歪ませたい、と考えるときもある。まぁ通常のアプローチでそういう思考になることはないが、特定のジャンルではあり得るのでそういう応用が考えつくか、かが重要。

例えばリバーブは基本、Low と High を削るよね、だって主線の邪魔になるから、普通は削るのがセオリーだし、通常 Reverb EQ に Low shelf Boost や High Shelf Boost は基本的には上手くいかない。

しかし、Early Reflections は短い時間の反射なのでそこで Low を Boost しても邪魔にはならない場合も出てくる。そして Reverb Tail も逆にどうしても高域減衰の方が早いので High Boost が Reverberation 要素だけに有効できる場合、また違った浮遊感を演出できる。

つまり、よく語られる Reverb のセオリーなんてものは知恵や Reverb の各パラメータへの深い理解があれば余裕で覆す事もできる。

要は、イジれるパラメータをしっかりと理解しなきゃいけないって話に収束してしまうのだけれど。

P930 Lunar Lander – Pulsar Modular

そして、Reverb の基礎が大体わかってくると、集大成としてここに行き着く。

私は Delay と Reverb は結構分けて考えてきました。

だって、こういう複合的なアプローチを提供するプラグインがなかったからです。もちろん、初期の Tape Echo は実は Delay と Reverb の組み合わせの製品があるので、擬似的な空間を初歩的なエフェクトで再現しようとしていました。多分…

私は初期反射を勉強する前に Short Delay にはどんな意味があるのだろうか、と自問自答してきました。正直、よくわかりませんでした。Slap Delay がピッチベンドしたりすると、歌が太く聴こえる、とかがありましたが、正直先輩エンジニアのパクリでした。

後に初期反射について考えるときが Exponential Audio の Reverb を手に入れて得られました。その後、Short Delay について初期反射の替わりになるものだと、個人的に解釈しました。

そしたら、Pulsar Modular が私と同じように変遷をたどり、Reverberator (Plate) と BBD Delay を使ったアプローチを製品化してくれました。面白いほど個人の研究とプラグインの開発者の意見が交わります。

もちろん、テープエコーなどの古い技術というかアプローチも取り入れているプラグインであり、Reverberator の Delay も表現できるし、BBD Delay を Reverb に送ることもできるし、これ自体のアプローチとしては実は古いものも内包している。

そして、考え方によっては、このプラグインは BBD Delay の構造は好きなような初期反射を合成することにあります。私が言ったように、初期反射にモジュレーションや個別の EQ そして Saturation を加えたい、という欲望を叶えてくれるプラグインになっちゃうのです。

もちろん、部屋とか空間の合成とか距離感や立体感の話ではないんですよ。

今まで皆さんは散々、Reverb は空間の再現なのだ、奥行きなのだ、立体感なのだ、って聞いてきたと思いますが、全くそんなことではないのです。

音の体格というか音のエンベロープ形成の話が一番近くて、奥行きだとか立体感だとかは、リバーブではぶっちゃけ作れません。Reverb + α が必要なんです。ただ、周波数特性の変化やエンベロープの変化で立体感のような錯覚を得ることがありますが、個人的に重要なのは、Early Reflections と Reverberation を自由に操って目的の音像にすること、であるのですよ。

別に部屋を再現することではないんです。もちろん、音の構築の途中経過に部屋の再現がありますが、そこはゴールじゃない。重要なのは MA の場合は「画」とマッチするかで、音楽の場合はその音楽性と整合性が取れるか、でしかありません。

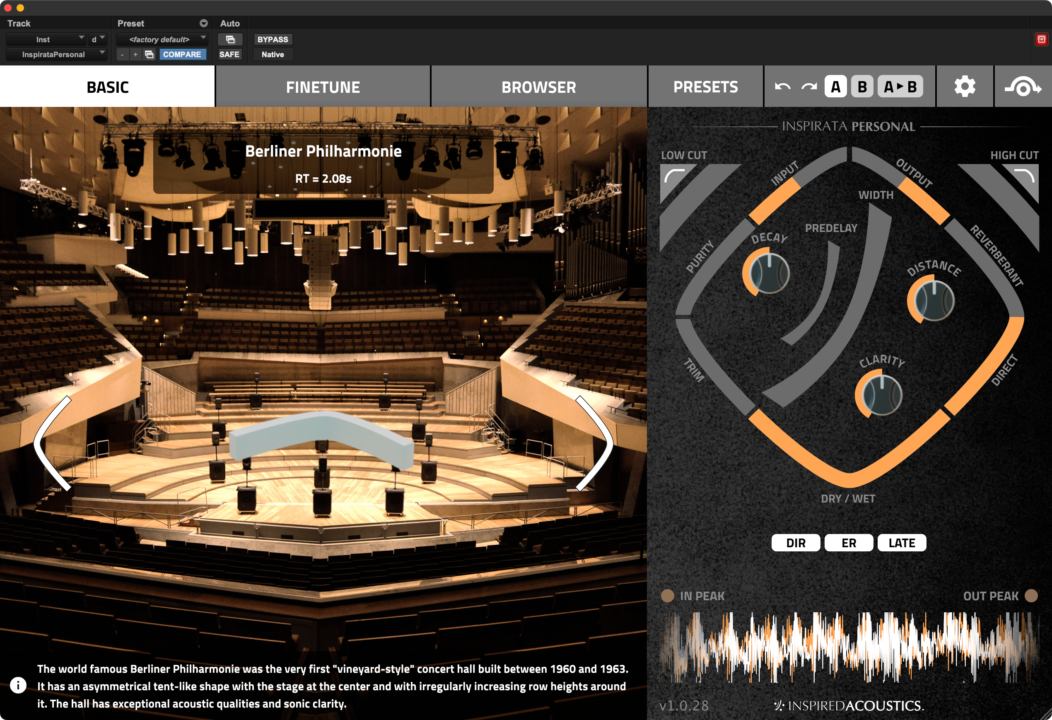

INSPIRATA – Inspired Acoustics

だけど、やっぱり空間って大事でしょ!?

そうなんだ、そういう人向けに INSPIRATA だと思う。

これはもう、Early Reflections とか Reverberant とかあんまり関係ない、空間をそこに再現って感じの高級 IR Reverb。

これはね、Direct という新しい概念を取り入れた IR Reverb で、詳しいことは知らないけど、ヒジョーにざっくりいうとたぶん、IR の周波数特性や色々な物理特性を適応するっていうやつだと思う。具体的には 3D モデリングの最短距離がなんちゃらの物理演算っぽいんだが詳しく説明する回じゃないで割愛。そこに、IR の初期反射成分と残響成分を足していくっていう、変態設計なんだ。直接音重視なミックスが最近は多いから AUX 専用っちゃ専用。

筆者はこの Reverb を 空間の表現のために利用していない。利用する理由は初期反射のタイムと残響のタイムが自分の思い描く音に近そうなものを選んで、音を再形成するために利用しており、部屋の響きとかはぶっちゃけ考えていません。

もちろん、ある程度の部屋の種類は考慮しますが、それ自体はプライオリティは高くなく、正直、きれいな響きや曲を邪魔しないようなレゾナンスが少ない響きを追求したいのであれば、このような「反射の極限」のような IR を使うべきじゃない、だって Comb Filtering だらけの音になるのは明白でしょ…?

だからこの Comb Filter 要素をうまく利用していくアプローチが必要になってくるんだよね。Chorus だって Flanger だって (ノッチフィルター要素が強いが) この Comb Filtering が非常によく発生する典型のエフェクトではないですか。真理はやはりこういう部分にあると思います。

こいつも、とにかくパラメータが独自かつ豊富過ぎて使いこなすのは常人には無理でしょ、レベルなんだけど、現状めっちゃ使う。とにかく操作方法がわかってしまえば目的の音像へは瞬時に到達できるようになる。

パラメータは全く独自路線のため、今までの学習は全く役に立たない、役に立つとするならば、どのように人間が方向や空間を認識しているのか、を普通に音響工学的な視点と音響心理学的な視点の知識があればパラメータを触ることは容易なんだが、そんなの一般人には無理なわけで。

そういう話は僕がすると、すぐに警察が飛んでくるので面倒なんでやりません。

総括

もし、あなたが立体感だとか、空間表現だとか、そういうもの自体に興味があるというか、そこにフォーカスしたいのであれば、Transient の記事を購入して読んでみてください。そこに答えが書いてあります。ただし、Reverb の制御についてかなり深く理解している前提でもありますが。

ここでは解説しません。実は 立体感 だとかリアルな表現は Reverb も大事なんだけどそれよりも動きとか瞬間の制御であって、2ch の制限の中でどうやって誇張表現を行うか、とか、そういう視点なのです。

ですから Reverb の項目とは実は違う視点で話をしなくてはいけないため、ここでは解説しません。

合わせて読みたい

Reverb を使うのは、正直、なんかのっぺりしてるなぁー、とか、音の厚みの感じが足りないなぁー、とか、譜面と譜面の間の隙間がちょっとチグハグだなぁー、とか、エンベロープのデザインがいまいちだなぁー、とか、そういう時に使うんですよね、全然上手く説明できません。

ただし、これを使うなら、こうするよ、という逆説的な説明だったらできる、という話でした。

理解してくれたかな…?

使う理由は様々なんですよね、個人の数だけ意図があると思うのですが、教える立場からすると、これを使うには、こういうアプローチや知識や知恵があると、いいですよっていう説明しかできないのです。

だから Reverb くそ難しい。

お仕事依頼、ミックスレッスンについて

筆者はレコーディング、ミックス、マスタリングを業務的に行っている音楽のエンジニアです。主な制作を海外を軸として活動しています。制作のご依頼等は こちら をご参照ください。